CAPÍTULO I. EL MERCADO DE LOS DATOS

Vivimos en un período de emocionantes innovaciones y cambios. El World Economic Forum lo llama la web del mundo, dado que la comunicación, las nuevas tecnologías e internet interconectan a las personas en una misma red[1]. La accesibilidad a la información ha aumentado considerablemente, sobre todo gracias a la aparición de nuevos intermediarios, y se ha facilitado la transacción a través de las fronteras nacionales, tanto para individuos como para empresas. Este nuevo mundo, caracterizado por una profunda interconexión, ha visto surgir el desarrollo de una verdadera economía digital, con sus propias reglas, triunfadores y perdedores. Entre estos últimos encontramos empresas que no han querido, o podido, transformar su modelo de negocio de acuerdo con los cambios de la revolución tecnológica, mientras que, entre los ganadores, figuran las llamadas ‘plataformas digitales’. Esta expresión alude a compañías cuyo modelo de negocio permite a múltiples participantes conectarse con ellas, interactuar entre sí, y e intercambiar valor. La Comisión Europea las define como “todas aquellas empresas que cubren diferentes tipos de actividades como online marketplaces, social media, plataformas de distribución de aplicaciones, páginas web de comparación de precios, plataformas para la economía colaborativa, así como motores de búsqueda online”[2]. Es importante considerar también que determinadas plataformas digitales han ido adquiriendo más poder en sus mercados y, por tanto, más atención por parte de las autoridades y del debate público. Por consiguiente, aunque todas ellas puedan presentar características parecidas, el interés de este informe se centra sobre todo en algunas de ellas: las que han conseguido ganar más cuota de mercado y están teniendo un mayor impacto, ya sea en los beneficios o en los riesgos para la sociedad (capítulo 2).

Como veremos en el curso de este estudio, el núcleo del modelo de negocios de estas nuevas empresas consiste, sin duda, en la recopilación y gestión de ‘datos’, un término que engloba el conjunto de información procedente de los usuarios de estas plataformas: quiénes somos, nuestros intereses, nuestro pasado y, probablemente, pinceladas sobre nuestro futuro más cercano. Este inmenso flujo de datos ha creado nuevas infraestructuras, nuevos negocios y, fundamentalmente, nuevas economías, así como nuevos desafíos para la sociedad. Esta revolución promete originar un cambio radical, al que ya estamos, en parte, asistiendo en muchas industrias, por ejemplo en la sanidad y las finanzas[3]. Por todas estas razones, resulta de primordial importancia entender cómo funciona este mercado y la importancia de los datos de cara a que una empresa siga siendo competitiva.

Por ello, en esta introducción se presentarán algunas características fundamentales de las plataformas digitales, que explican tanto su funcionamiento general como los orígenes de su reciente éxito. Al mismo tiempo, esto permitirá comprender mejor sus problemas más relevantes (capítulos 2 y 3).

Para realizar esta semblanza, no puede dejar de considerarse el mecanismo del mercado de datos, base del modelo de negocio adoptado por las compañías cubiertas por el estudio. Una vez investigado este elemento, se abordarán las tres dimensiones que explican la clave para ganar en la economía digital. Son los rendimientos crecientes de escala, los efectos de red, y el ciclo virtuoso de los datos.

El mercado de los datos

Como se ha mencionado anteriormente, los datos personales se identifican con todo tipo de información que una persona física o una empresa deja en la red: sus movimientos, intereses, relaciones y rastros que, más o menos conscientemente, se introducen en internet. Así, se puede pensar en los datos de un usuario como si de su registro digital se tratase, en el que queda plasmada su evolución dentro de la web. Dentro de este registro, los datos evolucionan en función de la información que se provee a través de las plataformas digitales, y se almacenan en alguna base que forma parte de las identidades digitales de los usuarios. Sin embargo, no todos estos datos los producen o los facilitan ellos mismos. El World Economic Forum los categoriza, según su forma de adquisición, en tres grupos: voluntarios, observados y deducidos. Los voluntarios son los datos que la persona da directamente a la plataforma a cambio de recibir un servicio. Por ejemplo, los bancarios, cuando se compra un producto por internet, o los personales a la hora de suscribirse a una plataforma. Los observados se encuadran en el historial de movimientos que un individuo hace dentro de una plataforma online. Por ejemplo, las compras, o las preferencias que se pongan para recibir más servicios: la plataforma las observa y las adquiere, para poder ofrecer más prestaciones parecidas en el futuro. Por último, los deducidos no los proporcionan los individuos, sino que se consiguen a través de un análisis de los datos voluntarios e históricos. Son los que permiten a una empresa resultar más competitiva que las demás, porque, a través de ellos, estudia la información que recibe, y saca conclusiones ventajosas para su negocio. Por ejemplo, analizando datos voluntarios y observados, tiene la oportunidad de descubrir otros intereses que no están declarados específicamente. Cada tipo de estos datos personales (voluntarios, observados o inferidos) puede ser creado por múltiples fuentes (dispositivos, software, aplicaciones), almacenadas y agregadas por diversos proveedores (minoristas web, internet, motores de búsqueda, o empresas de servicios públicos) y evaluados para una amplia variedad de propósitos y muy diferentes usuarios (finales, empresas, organizaciones públicas)[4].Por eso, la delimitación entre los diversos tipos de datos no siempre es clara.

Esta sistematización abre la puerta a una ulterior consideración sobre la propiedad de los datos y su accesibilidad. Aunque, en su mayoría, los producen los usuarios (por ejemplo, por medio de publicaciones en redes sociales, correos electrónicos y mensajes instantáneos), la respuesta a la pregunta «de quién son y cuán realmente accesibles» parece menos obvia. Tras la aprobación por parte de Europa del Reglamento General de Protección de Datos (GDPR), que desglosaremos con más detalle en el capítulo 4, para los ciudadanos europeos está vigente hoy la posibilidad de solicitar sus datos, pero el proceso para obtenerlos ciertamente no destaca por su velocidad y simplicidad[5]. El hecho de que las plataformas digitales retengan los datos de sus usuarios, a menos que estos los pidan de manera explícita, no tiene en cuenta que, a partir de su acumulación y de una fácil lectura, los internautas podrían aumentar el conocimiento de sí mismos, y subestima el riesgo de fuga de información en caso de que los datos se pirateen o, simplemente, se vendan. Por otro lado, como veremos a lo largo del informe, las plataformas digitales se alimentan de la disponibilidad de datos para mejorar su posición en el mercado y llegar, incluso, al monopolio (en particular, a través del ‘efecto de red’ que se describe más adelante). Superar este riesgo, y asegurar que los beneficios de la competencia continúan redundando en el sector, implica repensar el concepto de derechos de propiedad de los datos, mediante la aplicación de reformas análogas a las que se han avanzado en el pasado en sectores como el de la telefonía móvil. De hecho, en esta última área, la mayoría de los países han establecido el derecho a la ‘portabilidad’, por el cual el número de teléfono pertenece al usuario y no a la compañía que lo suministra, lo que promueve la competencia entre las empresas y reduce los precios para el consumidor. Del mismo modo, varios autores están postulando la hipótesis de que los usuarios posean la propia red de relaciones digitales (‘social graph’) que han creado en una red social y que, por lo tanto, puedan transferirla fácilmente a una nueva plataforma sin perder su red de ‘amigos’[6].

Otra característica importante dentro del mercado de los datos hace que haya que plantearse las distintas maneras en que estos se pueden utilizar. La Comisión Europea define cuatro categorías de uso: uso no anónimo de datos individuales, uso anónimo de datos individuales, datos agregados y datos contextuales[7]:

- Con el uso no anónimo de datos individuales, se refiere al que se les da para ofrecer un servicio a un individuo. Por ejemplo, una empresa que vende productos online los utiliza para combinar mejor las preferencias de las personas con nuevos o diferentes productos que les podrían interesar.

- El uso anónimo de datos individuales sirve cuando con ellos se pretende mejorar un programa de machine learning[8].

- Los datos agregados se utilizan a nivel grupal, caso de los que ofrecen las instituciones públicas acerca de la población de un país.

- Los datos contextuales son aquellos externos a los individuos que se emplean para ofrecerles un mejor servicio: de localización, temperatura, lugares, etc.

Los diferentes tipos de datos y categorías de uso son conceptos necesarios para entrar en el debate sobre su protección y la privacidad, porque explican la heterogeneidad y la complejidad de este mercado. Además, hay otras características a tomar en cuenta cuando se habla de la economía digital, ya que aclaran por qué estos nuevos modelos competitivos no siempre resultan compatibles con los tradicionales. Así, muchos de los más innovadores mercados digitales derivados de internet, como los motores de búsqueda, las redes sociales o el e-commerce sufren de una altísima concentración, que los hace estar dominados por una o unas pocas empresas. En las siguientes páginas, describiremos las principales razones por las que estos mercados son distintos y, por tanto, necesitan de nuevas propuestas:

- Las plataformas digitales han logrado, gracias a los distintos tipos de datos, que los rendimientos de escala sean crecientes. Esto significa, por un lado, que el coste marginal disminuye conforme aumenta el número de usuarios y, por otro, que adquirir un nuevo dato resulta siempre positivo para la plataforma digital.

- Los efectos de red (network effects): La conveniencia de utilizar una tecnología o un servicio se incrementa con la cantidad de consumidores que lo adoptan. En consecuencia, no basta con que un nuevo participante ofrezca una mejor calidad y/o un precio más bajo que la empresa ‘incumbente’; la startup tendrá también que convencer a los usuarios del titular para coordinar la migración a sus propios servicios.

- El ciclo de la Inteligencia Artificial (IA): Con los avances de esta y de las nuevas tecnologías, las compañías pueden utilizar los datos en manera exponencial, creando un círculo virtuoso dentro de sus modelos de negocio.

1. Rendimientos de escala

La economía digital se trata ante todo de un mercado de información. Las plataformas digitales y todas las empresas que centran su modelo de negocio en los datos, en el fondo, los venden para mejorar un servicio o lanzar nuevos productos. Sin embargo, la teoría económica considera la información como un bien público, es decir, no rival y tampoco excluyente[9]. Esto quiere decir que no se puede vender como tal, dado que ofrecerlo a otro individuo o empresa no excluye que se pueda seguir utilizando. Si, junto a esta definición, se toma en consideración la actual monetización que las empresas digitales hacen a partir de estos datos, es fácil ver como la posesión de información solo puede tener efectos positivos para una compañía y, por tanto, implica unos rendimientos de escala crecientes. Por esto, aunque el coste inicial de conseguir datos sea alto, en cuanto se atiende a un usuario adicional, los costes no aumentan proporcionalmente. De hecho, una vez creado un bien digital, su coste de transmisión a otros individuos es prácticamente nulo.

Respecto a este punto, hay dos cuestiones que sirven como ejemplo para entender la fuerza de los rendimientos de escala crecientes dentro del modelo de negocio de las plataformas digitales. Por un lado, según datos de Facebook a fecha 31 de marzo 2019, esta red social tiene alrededor de 65.000 usuarios mensuales por cada trabajador[10]. Por otro, esta compañía puede permitirse gastar en torno al 1% de su valor anual en pagar a sus empleados, porque obtiene el resto de su trabajo de forma ‘gratuita’ por parte de los usuarios. En contraste, si se contempla una empresa con un modelo de negocio más tradicional, por ejemplo Walmart, esta destina el 40% de su valor a salarios[11]. Además, los rendimientos de escala crecientes crean barreras de entrada y, por ende, constituyen una restricción a la competencia. Así, las plataformas digitales, gracias a un número de clientes elevado y un coste promedio bajo, se hallan en disposición de ofrecer productos a bajo precio y de buena calidad; una que una nueva empresa no puede igualar sin acometer la misma operación a gran escala para pagar los costes fijos. Una start-up interesada en brindar un nuevo servicio solo logrará alcanzar una gran escala si la calidad es alta. Por consiguiente, un potencial participante no entrará en el mercado para desafiar a la compañía dominante.

La presencia de grandes economías de escala también ayuda a comprender el incremento de los servicios gratuitos. Las plataformas digitales han conseguido distribuir servicios ‘gratuitos’ a cambio de datos, ya que sus mayores ingresos derivan de la publicidad. Esta coincidencia de nuevas necesidades y de falta de conocimiento por parte del usuario acerca de las nuevas tecnologías han creado un tipo de economía de trueque entre plataforma y consumidor en el que los datos se intercambian por servicios. Por tanto, los datos se han convertido en un producto que, a su vez, se transforma en capital para las empresas, y que les permite utilizarlo como si fuera de su propiedad. En este informe, estudiamos una posible alternativa a este uso de los datos por parte de las plataformas digitales que cambiaría su modelo de negocio por completo y lo haría más eficiente.

2. Efectos Network

El segundo aspecto que diferencia este mercado de un modelo clásico es el ‘network effect’, es decir, la conveniencia de usar una plataforma está directamente relacionada con el número de usuarios que está en ella. Pensamos por ejemplo en Facebook o LinkedIn: su éxito reside en que muchos individuos estén conectados a través de la misma red. Como veremos en los siguientes capítulos, este efecto tiene doble impacto para la ´incumbente’: por un lado, es positivo porque hace más alta la barrera de entrada a posibles competidores; por otro, una vez que una compañía consigue entrar en el mercado y captar a muchos clientes, la empresa que la ha precedido se puede volver completamente obsoleta (i.e. MySpace, o MSN). Por ello, los mercados con efectos network se muestran propensos a la concentración: los consumidores se benefician de hallarse en la misma red que otros usuarios. Nadie quiere estar solo en su propia red social.

Un caso interesante dentro del network effect es el de las plataformas de múltiples lados, también conocidas como matchmakers, que agregan en una sola a distintos grupos con intereses complementarios, para que se intercambien bienes y servicios. El ejemplo más claro lo encontramos en Airbnb, que conecta a los propietarios de apartamentos con los inquilinos. Vale la pena señalar que este tipo de negocio se ha empleado mucho en los últimos años en el mundo de las fintechs para entrar en diferentes industrias y romper completamente sus modelos de negocio. Pensemos en el sistema de pagos, en los préstamos entre particulares (P2P Lending), o en el crowdfunding. Para todos estos sectores, existen plataformas digitales que han logrado unir a los consumidores con los oferentes, dejando de lado al intermediario.

También en este aspecto las plataformas encuentran una ventaja en no cobrar a los usuarios que desean entrar en su sistema, ya que saben que los datos que les proveen servirán para imputar un precio mayor a las empresas de publicidad y a las que quieren atraer más clientes. Así, los usuarios de Gmail pagan un precio monetario de cero, pero permiten que Google lea sus correos electrónicos para que los anunciantes puedan comercializarlos en función de su información personal. Google, en cambio, puede cobrar un alto precio por los anuncios.[12] Como en el caso de los rendimientos de escala, los efectos de red también hacen que resulte muy complicado para una nueva empresa entrar en un mercado donde haya ya una plataforma. La razón está en la dificultad para los usuarios de moverse en masa hacia la nueva, y en la falta de incentivos a nivel individual de cara a moverse desde una plataforma donde haya un grupo de interés a otra que se está formando. De este modo, los efectos de red podrían impedir que una nueva plataforma sustituya a otra antigua. Incluso, aun cuando no se puedan evitar, estos ‘efectos’ hacen que la transición sea más lenta y costosa para el nuevo líder del mercado de lo que podría haber sido[13]. Estas altas barreras de entrada debidas a los efectos de redes llevan a pensar que el mercado tal vez sea más eficiente cuando haya un monopolio. A partir de este supuesto, que discutiremos a lo largo del informe y frente al que propondremos una solución más satisfactoria en términos de libre competencia, algunos autores sugieren que la mejor manera de limitar estos monopolios consiste en una política de regulación, en vez de en crear un mercado más competitivo y abierto a otras empresas[14].

Esto resulta especialmente importante desde el momento en que el interés de las plataformas diverge del interés público. Las grandes plataformas sociales como Facebook, Twitter y Youtube están ocupando cada vez una posición más preeminente como intermediarios en el debate y en la formación de normas culturales[15]. Esto tiene relevantes efectos secundarios en la esfera social más allá del ámbito de las plataformas. Por lo tanto, no hay razón para esperar que estas gestionen la situación de manera eficiente: cuentan con un incentivo para usar su papel dominante y aumentar de este modo su influencia política[16].

3. El ciclo virtuoso de los datos

El último aspecto que merece la pena señalarse es cómo la evolución de la tecnología ha ido afectando al mercado de los datos. La idea de que la información sobre los usuarios sea el activo central para los gigantes de la tecnología se hizo cada vez más relevante con la explosión del big data, del machine learning y de la inteligencia artificial en los modelos de negocio de las empresas y en aspectos de nuestra vida cotidiana[17]. De hecho, como sugiere el informe de la Comisión Europea, los datos son uno de los ingredientes clave de la inteligencia artificial (IA), y un aporte crucial para los procesos de producción, de logística y del marketing dirigido. La capacidad de usarlos y de desarrollar aplicaciones y productos innovadores se trata de un parámetro competitivo cuya relevancia seguirá aumentando[18]. En muchos sentidos, la inversión en big data se ha movido hacia la inteligencia artificial, hasta convertirla en la fuerza impulsora detrás de la recolección de datos de muchas organizaciones y de los esfuerzos de monetizarlos, bajo la premisa de ofrecer mejores servicios y productos a los usuarios, a través de estas nuevas tecnologías. En el centro de la implementación de la IA se halla una de las técnicas del machine learning denominada supervised learning, que utiliza aquella para descubrir una relación de A a B. Por ejemplo, un sistema que determina si un correo electrónico es spam o no, o bien los objetos en una imagen. En otras palabras, asimila datos y genera un resultado. Esta información se puede presentar en formatos estructurados (hojas de cálculo) o no estructurados, como audio, vídeo y texto. Cuantos más datos tengan a su disposición, más potentes serán los algoritmos. Sin embargo, la tecnología que ha permitido a la IA crecer exponencialmente en los últimos años es el neural networks, o redes neuronales[19]. En los modelos tradicionales de machine learning, aunque creciera el volumen de los datos, las posibilidades de la IA resultaban limitadas. Ahora, gracias a estas redes neuronales, la barrera se ha roto y el rendimiento de la IA ya solo depende de dos aspectos: la cantidad de datos y la potencia computacional. Así, si se procesan más datos en mejores redes neuronales, la evolución de la IA será cada vez mejor. En el libro Radical Market, sus autores explican exhaustivamente el funcionamiento de estas neural networks. En lugar de que los inputs determinen de forma directa e independiente de los outputs, con las redes neuronales, los inputs se combinan en formas complejas para crear ‘características’ del fenómeno que se está estudiando, lo que a su vez condiciona otras, que acaban por hacer lo proio con el resultado[20]. Esto nos adentra en el último punto de la actual fuerza de los mercados de datos: el ciclo virtuoso de la IA.

Este empieza con una empresa que, a través de la creación de un producto, consigue usuarios, los cuales ofrecerán más datos al utilizar aquel. La adquisición de esta información por parte de la empresa, junto con la integración de las tecnologías de IA, permitirá crear o perfeccionar el producto para el consumidor, creando un circuito de retroalimentación por el cual el producto mejora continuamente con el uso, lo que hace que este se incremente, y obtenga una mejor posición competitiva en relación con otros. Este circuito virtuoso, unido a las redes neuronales, ha llevado a las plataformas digitales a jugar un papel cada vez más importante en el mercado e invertir más capital para conseguir más información de los usuarios. Así, los vastos conjuntos de datos recopilados por Google, Facebook y otros como un subproducto de sus funciones comerciales básicas se han convertido en una fuente crucial de ingresos y de ventaja competitiva. Las compañías que comenzaron como proveedores de servicios libres y que se transformaron en plataformas de publicidad ahora están en proceso de convertirse en recolectores de datos, por medio de servicios que atraen a los usuarios y les incitan a proveer información con la que desarrollan la IA a través del machine learning.

Profundizar en estas características permite identificar en la dimensión de los datos el componente principal del modelo de negocio de las empresas activas en la economía digital. A lo largo de este informe, trataremos de comprender qué problemas plantea esto y los desafíos que debe enfrentar nuestra sociedad para equilibrar los beneficios obtenidos con las amenazas relacionadas (capítulo 2). En particular, nos centrararemos en el tema de la privacidad y la protección de datos (capítulos 3 y 4), que cada vez están jugando un rol más importante en el debate acerca de las plataformas digitales. En el núcleo del problema hay una consideración simple: el modelo de negocio de estas compañías se basa en un incentivo continuo para capturar un número creciente de información sobre sus usuarios y ser lo más competitivas posible. La necesidad de acceder a nuevos datos y la facilidad con que estos se consiguen a menudo desmboca en la pregunta de si todavía tiene sentido hablar de privacidad[21]. Respecto a esta visión de un ‘final de la privacidad’, de la que luego se retractó parcialmente su propio autor[22], veremos más adelante cómo es más exacto hablar de una ‘paradoja de la privacidad’, según la cual cada vez más usuarios están preocupados por su privacidad, pero, a la vez, comparten también más información personal.

Abordar este problema, que considera que el respeto por la privacidad, entendido como un derecho humano universal (artículo 12), se entrelaza con la protección de datos, constituye un desafío que afecta a nuestra sociedad de manera interdisciplinar. Al tratar de contribuir a este debate, veremos que detrás de las soluciones propuestas, se esconden con frecuencia diversas concepciones filosóficas. Nuestro punto de vista a este respecto tomará los datos empíricos, donde estén disponibles, como un punto de partida. Se compararán con el patrimonio intelectual de la tradición liberal clásica, que ha hecho de la defensa de la privacidad un caballo de batalla. En este sentido, resultará interesante observar cómo, incluso si el respeto por el derecho a la privacidad se opone históricamente al control estatal, la preocupación actual se refiere más bien a su protección frente a la violación por parte de las empresas. Al ahondar en este aspecto, constataremos qué tipo de soluciones reglamentarias se están implementando (capítulo 4), especialmente a nivel europeo, para afirmar este derecho.

Finalmente, la regulación de la privacidad en la economía digital no puede sino formar parte de un enfoque más general respecto a las plataformas digitales, cuyas soluciones actualmente más en boga se desgranarán en el capítulo 5, y se cotejarán con las enseñanzas del liberalismo clásico en el 6.

CAPÍTULO II. LAS BIG TECH

En el primer capítulo, hemos introducido el mercado de datos y hemos analizado varias características que pueden estar relacionadas con su estructura de mercado y que pueden conducir a una falta de competencia entre empresas y a una situación de monopolio en diferentes industrias. En este capítulo, explicaremos las consecuencias que tiene el mercado de datos para el modelo de negocio de las plataformas digitales y cómo se irá desarrollando en el futuro.

Como anticipamos en el capítulo anterior, no es fácil encerrar en una sola definición los diferentes tipos de plataformas. Por ello, de aquí en adelante, las definiremos como aquellas empresas tecnológicas que compartan la integración en su línea de negocio de una plataforma abierta en la que los usuarios intercambien bienes y servicios, y que vendan los suyos propios[23]. Esta característica en concreto ha llevado a muchos políticos, académicos e intelectuales a cuestionar el éxito de estas plataformas y a compararlas con otras industrias o sectores que han devenido en casos de oligopolio a lo largo del tiempo[24]. Está claro que cualquier compañía que tenga la posibilidad de gestionar una plataforma y de vender sus productos en ella acabará obteniendo beneficios, lo que aumentará cada vez más su poder de mercado frente a los demás participantes. Las empresas que más éxito han cosechado en este aspecto son las GAFAs: Google, Amazon, Facebook and Apple (ver BOX I). Cada una de ellas ha logrado unir las dos líneas de negocio que acabamos de mencionar y crear una posición dominante dentro de sus plataformas[25]. En este capítulo, trataremos dos temas relacionados con las GAFAs. Por un lado, algunas de las estrategias que utilizan para conseguir más poder y ofrecer mejores servicios (la publicidad digital (‘digital advertising’) y la inteligencia artificial). Por otro, las amenazas que estas mismas empresas generan para nuestra sociedad.

Digital Advertising

Uno de los aspectos que más réditos arroja para estas plataformas es el ‘digital advertising’, es decir, el saber dirigir las ofertas y productos a los usuarios que pueden estar interesados. Facebook y Alphabet (el holding de Google) obtienen más del 90% de sus ingresos gracias a la publicidad digital[26], y controlan más del 60% de este sector[27]. Sin embargo, este no se limita a ambas plataformas. En los últimos años, Amazon y otras han aumentado su inversión en publicidad para mejorar sus servicios, y llegar con más facilidad a potenciales clientes. Por ejemplo, Amazon puede conocer la última vez que una persona ha comprado un determinado producto y cuál es su marca favorita. Los anunciantes son susceptibles de utilizar esta información para encontrar el mejor target y saber cuándo un potencial cliente necesita un determinado bien[28], con más eficiencia y menos costes. Tomemos como ejemplo un fabricante de gafas de sol. Antes de que existiera la publicidad digital, esta empresa necesitaba pensar en qué revistas y canales de televisión insertaba su publicidad para atraer más consumidores. Esta estrategia resultaba muy cara y poco eficiente, porque no permitía controlar con exactitud qué personas veían esa revista o canal justo en el momento en que aparecía el anuncio. Hoy en día, gracias a la publicidad digital, tanto impactar al cliente interesado como programar la publicidad en determinados momentos resulta más fácil. Siguiendo con nuestro ejemplo, el fabricante de gafas sabrá si la persona está buscando otras gafas de sol, ropa de verano, o si ha salido un día soleado. Toda esta información pueden recogerla las plataformas digitales como Amazon, Google y Facebook, proporcionársela a las diferentes empresas, y así facilitar su búsqueda[29]. A su vez, los servicios de publicidad ofrecidos por estas plataformas a las compañías han posibilitado que las primeras aumenten su número de usuarios (a través del network effect) y conocer los mejores productos y servicios de las segundas.

Antes de describir las consecuencias que la publicidad digital ha entrañado para la economía digital es importante entrar con un mayor detalle en el funcionamiento de esta estrategia. A continuación, explicamos diferentes modelos relacionados con la publicidad digital, utilizando como punto de referencia los dos que han reportado más éxito: Google AdWords y Facebook Ads, los respectivos departamentos responsables de las publicidades de Google y Facebook.

Google AdWords sigue principalmente un sistema de ‘pay-per-click’ (PPC). Es decir, Google cobra a los anunciantes cada vez que un usuario pincha en su publicidad. La aparición de esta a través de AdWords depende de dos factores. Primero, de que las palabras clave de la búsqueda coincidan con las que los anunciantes han asociado a la suya. En segundo lugar, del ‘Ad Rank’ de la empresa respeto a sus competidoras. Este ranking de compañías está sujeto a su vez a dos elementos: el precio que los anunciantes están dispuestos a pagar por cada clic (siguiendo un sistema de pujas) y la calidad de los anuncios[30]. Estas dos métricas se multiplican entre sí, y el anunciante que obtenga el número más alto será el que primero aparezca en los resultados de búsqueda pagados. ‘The Quality Score’ depende de varios parámetros que permiten a los anunciantes pagar menos:

- El Click-Through Rate (CTR) del anuncio, o lo que es lo mismo, el porcentaje de clic que este genera respecto al número de impresiones, consideradas estas como las veces que un anuncio se muestra en pantalla por primera vez[31]. Si el anuncio PPC tiene 1.000 impresiones y 1 clic, equivale a un CTR de 0,1%. Como métrica, el CTR indica cuán relevantes son los buscadores para encontrar el anuncio. Por tanto, y aunque por regla general un CTR alto es mejor, hay que tener en cuenta la eficiencia de los anuncios. Un CTR bajo estará bien siempre que las palabras clave y anuncios se desempeñen correctamente en función de los objetivos comerciales.

- La relevancia de las palabras clave que activan el anuncio respecto a la búsqueda del usuario. Por ejemplo, ofrecer un producto gratuito en el anuncio solo para que los usuarios entren en la página web hará que el ‘quality score’ tenga una puntuación menor.

- La calidad de la página web, ya que, cuanto más relevante sea la página de destino respecto al anuncio, mayores posibilidades habrá de obtener un buen ‘quality score’.

Este sistema permite que no sea el anunciante que pague más el que logre mayor visibilidad. La calidad del servicio y la experiencia del usuario constituyen elementos fundamentales para que la publicidad recabe óptimos resultados. De hecho, cuanto más calidad tenga, menor será el precio que el anunciante pague[32].

Otro método utilizado por las plataformas, aparte del PPC, es el ‘Cost-per-mille’ (CPM), que denota el precio de 1.000 impresiones publicitarias en una página web. Los anuncios de Facebook presentan un costo promedio por clic (CPC) de 1,86 dólares, y uno por cada mil visitas (CPM) de 11,2 dólares, el cual varía en función de factores que van desde la calidad del anuncio hasta la competencia. Sin embargo, la verdadera fortaleza de la inmensa audiencia de Facebook radica en la granularidad con la que los anunciantes pueden dirigirse a los usuarios. Entre los modelos más utilizados en Facebook Ads figura el ‘lookalike audience’, una herramienta gracias a la que plataforma encuentra potenciales clientes basándose en los clientes pasados. Por ejemplo, un vendedor de libros que conoce su target puede ofrecer esta base de datos a Facebook, que le puede ayudar, a su vez, a hallar posibles clientes que comparten la misma información. Este tipo de publicidad ostenta un peso importante en una plataforma como Facebook, donde los usuarios comparten datos personales y privados con los demás miembros de la red social. Así, esta se trata de la plataforma con más información sobre intereses y relaciones. Eso sí, para que la publicidad dé sus frutos, es importante disponer de una base de datos de gran calidad. Si bien puede existir una mayor inclinación a maximizar el tamaño de las imitaciones, hay que tener en cuenta que las audiencias más pequeñas a menudo funcionan mejor, ya que, al fin y al cabo, son las que coinciden más con su fuente. Facebook recomienda usar una base de datos inicial de entre 1.000 y 50.000 personas para crear audiencias similares[33].

En conclusión, podemos apreciar cómo, a través de la publicidad digital, las plataformas no solo han encontrado uno modo de monetizar su negocio, sino también aumentar la cantidad de información personal de sus usuarios. La industria de los datos define el target advertising como una situación de ‘win-win-win’, en la que ganan los consumidores, los anunciantes y las plataformas. Es un bien para los consumidores, que ven una reducción en el coste de búsqueda de los productos; para los anunciantes, porque pueden hallar potenciales clientes más fácilmente; y para los intermediarios de datos, las plataformas, que captan dinero con estas transacciones[34]. A pesar de esto, un problema que queda sin resolver es el de la privacidad de los consumidores: el verdadero precio a pagar para beneficiarse de este sistema. Además, la situación de ‘win-win-win’ propuesta por la industria tecnológica no contempla la falta de transparencia en la publicidad de las empresas en Facebook[35].

El segundo elemento que crea preocupación en la opinión pública radica en el uso por las plataformas digitales de los avances de la IA para transformar sus negocios y entrar en nuevas industrias. Muchas de ellas han adoptado el machine learning y lo han integrado en su cultura corporativa. Como vimos en el capítulo 1, para estas empresas la IA no representa solo otra herramienta, sino la fuerza impulsora de su modelo de negocio. Esta filosofía las distingue de casi todos los demás, otros gigantes tecnológicos inclusive, porque pueden usar aquella para analizar una biblioteca de datos digitales y obtener información valiosa sobre cualquier industria en la que elijan penetrar[36]. Educación[37], viajes, sanidad[38] y muchas más están siendo completamente revolucionadas por las plataformas digitales. En este informe vamos a analizar una de las que, hoy en día, está viéndose más afectada por estas compañías y por la IA en general: las finanzas.

Según el Bank for International Settlements (BIS), en el último año, los servicios financieros han supuesto casi el 11% de los ingresos de las Big Tech[39]. Aunque, gran parte de este sector se concentra en China y en otros países en vía de desarrollo, las plataformas digitales están aprovechando los altos costes del sistema bancario en Europa y Estados Unidos para entrar también en estos mercados. El World Economic Forum ha analizado las áreas financieras más afectadas por parte de las nuevas tecnologías: los préstamos y depósitos, los seguros, los sistemas de pagos, las inversiones, el mercado de capitales y las infraestructuras de mercado[40]. Aquí se estudiarán solamente los sectores que han visto a las plataformas digitales protagonizar este cambio, es decir, los sistemas de pagos y préstamos[41].

1. Servicios de pagos

Fue el primer servicio que las Big Techs introdujeron en sus modelos de negocio para superar la falta de confianza entre consumidores y vendedores[42], agilizar la compra de productos en sus plataformas y mejorar su utilización. De hecho, el aumento del IA ha implicado muchos cambios en el sistema de pagos, como el mayor uso de interfaces móviles para hacerlos más rápidos en contraste con el efectivo. Asimismo, ha ayudado a reducir el fraude[43]. Las principales plataformas digitales han aprovechado los avances tecnológicos y el círculo virtuoso de los datos para ofrecer sus propios sistemas de pagos. El modelo más sencillo es el de las aplicaciones como ApplePay y GooglePay, en virtud de las cuales los usuarios confían en las infraestructuras de terceros (tarjetas de crédito o sistemas de pago minoristas) para procesar y liquidar pagos. Un modelo más avanzado lo encarna AmazonGo, una tienda sin cajero que rastrea lo que los visitantes han puesto en su carrito y lo cobra automáticamente usando sus métodos de pago preferidos cuando salen de la tienda. Detrás de este sistema hay un esfuerzo notable en reconocimiento de objetos y de machine learning[44]. La última plataforma digital que merece la pena citar es Facebook, que quiere dar un paso aún más adelante creando una moneda virtual propia, la Libra. Su misión es muy ambiciosa: ofrecer un servicio de pagos a todas aquellas personas que no tienen una cuenta bancaria, es decir aproximadamente 1,7 millones de personas[45]. La idea pasa por imitar el modelo de WeChat en China[46], que ha conseguido unir diferentes negocios en una misma app y ponerse en el centro de la vida de las personas. El modelo de la Libra se compone de tres partes que funcionarán de manera coordinada para generar un sistema financiero más inclusivo:

- Se basa en una tecnología blockchain[47]segura, escalable y confiable.

- Cuenta con el respaldo de una reserva de activos diseñada para aportarle valor intrínseco.

- Se rige por el gobierno de la Asociación Libra, de carácter independiente, cuya misión radica en la evolución del ecosistema.[48]

Hasta el momento, 28 empresas, incluidas compañías de pagos, grupos de comercio electrónico y empresas de capital de riesgo, han desvelado que se convertirán en patrocinadores e integrarán esta tecnología en sus servicios[49]. El plan consiste en crear una nueva fundación sin ánimo de lucro con sede en Suiza, compuesta por 100 miembros del sector privado y de la sociedad civil con los mismos derechos de voto, para lanzar Libra en la primera mitad de 2020[50]. Libra encierra el potencial de llevar a toda una generación a un sistema financiero más formal que, a largo plazo, pueda ayudar a las personas a construir su crédito y ascender en la escala socioeconómica.

Si, por un lado, parece que el futuro de las monedas virtuales se perfila como cada vez más cercano y evidente frente a la utilización del efectivo y como un medio por el que más personas puedan entrar en el sistema financiero, por el otro, las autoridades de regulación y las instituciones públicas no han dejado de observar los riesgos que estas monedas pueden entrañar para el sistema financiero global y para la privacidad de las personas. El 2 de agosto de 2019, las autoridades de protección de datos de EE.UU., UE, Reino Unido, Australia y Canadá publicaron una declaración conjunta en la que expresaban su preocupación por las amenazas que revestían estos planes de Facebook y alertaban de que la Libra “puede convertirse instantáneamente en el custodio de la información personal de millones de personas”[51]. También pedían que se creen configuraciones predeterminadas de protección de la privacidad y que no se empleen los llamados «patrones oscuros», técnicas que alientan a las personas a compartir datos personales con terceros[52]. El segundo aspecto de inquietud se refería al sistema financiero global. Por un lado, Libra dejaría demasiado poder en manos de un grupo autoseleccionado de grandes empresas; por el otro, plantearía riesgos sistémicos más profundos, al interferir con la capacidad de los bancos centrales de vigilar sus sistemas financieros y operar una política monetaria normal[53].

Todos los modelos avanzados por estas plataformas representan un adelanto para nuestra sociedad y, sin ninguna duda, llevan aparejadas muchas ventajas para los negocios y las personas. Sin embargo, a través de estos nuevos servicios, las Big Techs pueden conseguir más datos personales y, por tanto, un mayor poder sobre nuestras vidas.

2. Préstamos y depósito

El segundo mercado en el que las plataformas tendrían un gran impacto económico es el de los préstamos. Como reporta el World Economic Forum, la IA será (es) un completa revolución. Los productos de préstamo se volverán cada vez más pequeños y ágiles a medida que se personalicen para usos específicos. La gama de clientes potenciales aumentará conforme los datos no tradicionales permitan atender a nuevos consumidores y operar en nuevas regiones. Por tanto, las plataformas digitales cuentan con la ventaja respecto a los bancos de personalizar el tipo de empréstitos de dos maneras: ofreciendo productos propios gracias a los datos personales de sus usuarios, y creando una plataforma de matchmaking para prestamistas y prestatarios. Además, con las nuevas reglas europeas del ‘Open Banking’[54] y del PSD2[55], les resultará más fácil conocer los datos bancarios de sus usuarios y, por tanto, ofrecer productos a quienes no se pueden permitir un crédito bancario.

Amazon ha abierto un sistema de préstamos a pequeñas y medianas empresas en Reino Unido y EE.UU. Aunque los números no alcancen la dimensión de los del e-commerce, el gigante americano está invirtiendo mucho dinero en este sector y espera crecer en los próximos años. Ebay, competidora de Amazon, también ha decidido entrar en este mercado a través de una colaboración con el Banco Santander. La nueva empresa, Asto, brindará préstamos a finales de este año[56] a las más de 200.000 pymes que venden productos a través de eBay en el Reino Unido. El objetivo principal del banco español pasa por competir con los gigantes tecnológicos y las Fintech, utilizando sus mismas estrategias: muchos datos de usuarios y flexibilidad dentro de la empresa a la hora de bajar los costes.

El camino de las Big Techs en el mercado de préstamos es todavía largo, dado que las plataformas aún no poseen muchos datos bancarios de sus usuarios. Sin embargo, la colaboración entre Ebay y Santander puede erigirse en un buen ejemplo de cómo los bancos y las plataformas pueden unirse para ganar en dimensión y eficiencia.

En este capítulo, hemos analizado diferentes negocios que las plataformas digitales han desarrollado a lo largo del tiempo. Posner y Weyl en Radical Market hablan de estas como “empresas que comenzaron como proveedores de servicios gratuitos en busca de un modelo de ingresos y se transformaron en plataformas de publicidad, y ahora están en el proceso de convertirse en recolectores de datos, ofreciendo servicios que atraen a los usuarios y les incitan a proporcionar información sobre la cual entrenan a la inteligencia artificial usando machine learning”[57]. Aquí añadimos un aspecto más a este proceso vital de las plataformas digitales: su capacidad de entrar en nuevos mercados gracias a los círculos virtuosos de la IA y a la enorme cantidad de datos que pueden procesar gratuitamente. En esta publicación, hemos presentado solo dos de los mercados en los que las plataformas digitales están interesadas. Sin embargo, hay muchas más industrias donde pueden entrar y convertirse en líderes.

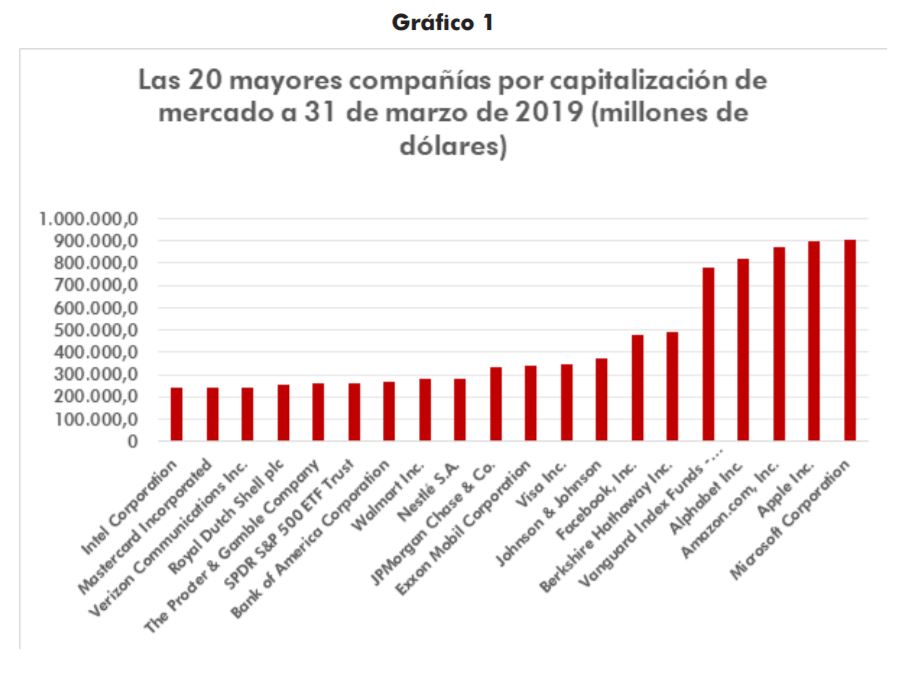

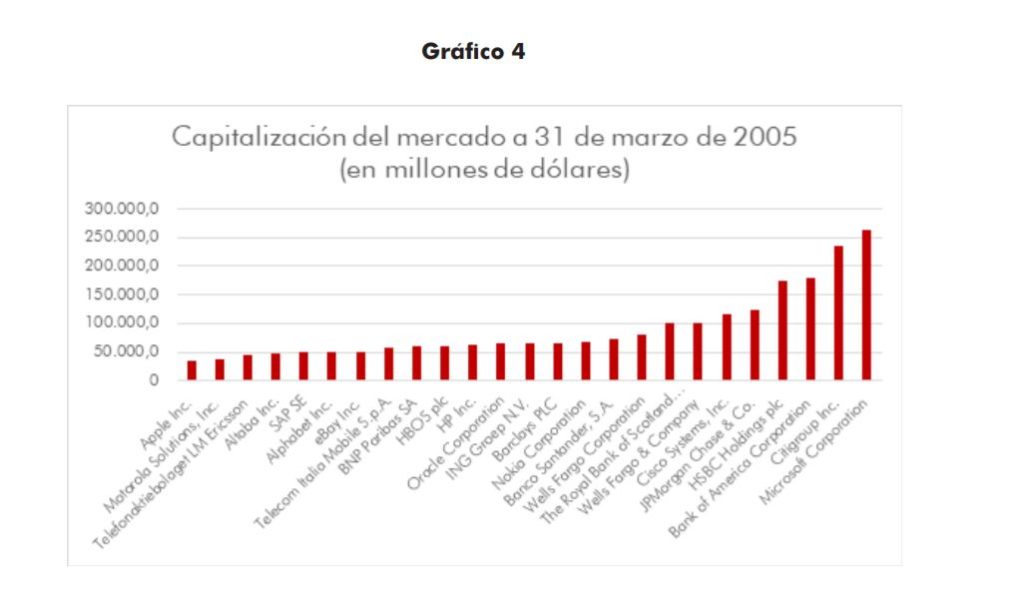

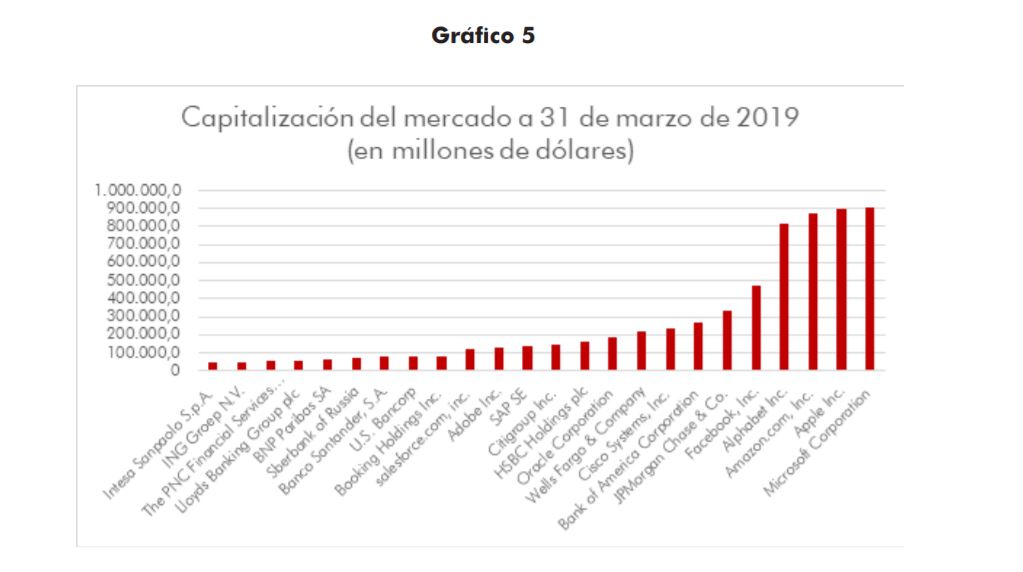

Muchas de estas plataformas han conseguido en solo 15 años erigirse en las empresas dominantes del mercado. Como se puede ver en la Figura 1, la capitalización de las GAFAs se halla hoy en día entre las mayores del mundo. Todas ellas juegan un papel muy importante en la sociedad actual: han sido las más innovadoras de los últimos años, al crear productos y servicios con un alcance global. Por eso, muchos gobiernos e instituciones han empezado a discutir sobre los riesgos que pueden encerrar estas plataformas, que son, ante todo, empresas privadas en busca de su propio beneficio. En este informe vamos a introducir brevemente diferentes aspectos que preocupan a la sociedad, para centrarnos luego en el punto principal de nuestra publicación: la privacidad y la protección de los datos personales.

El primer peligro que merece la pena tratarse y que ya hemos mencionado varias veces es el riesgo de monopolio que estas empresas presentan en sus respectivas industrias. En los últimos años, políticos y académicos han debatido sobre la posible existencia de una concentración de poder en las plataformas digitales y cómo esta pueda afectar a la competencia, la innovación y la estructura de mercado. Para explicar esta dinámica sirve el caso de Google.

Otro peligro relacionado con las plataformas digitales y su estructura de mercado se refiere a la democracia y los efectos en política. El caso de Cambridge Analytica (ver BOX II) basta para entender las perniciosas consecuencias que estas plataformas pueden originar en una sociedad democrática.

Por último, la privacidad: en los últimos tiempos, resulta cada vez más común encontrar noticias sobre algún escándalo relacionado ella, ya sea la ruptura de los cables de seguridad que defienden la información personal confidencial, o la revisión de las políticas de privacidad por parte de plataformas digitales que no cumplen las promesas precedentes sobre la defensa de sus usuarios.

Este tipo de noticias, cuando son difundidas por los medios de comunicación, generan un sentimiento generalizado de pánico, que deriva en la voluntad de retirarse de la plataforma objeto de la polémica o, en el mejor de los casos, en una creciente desconfianza hacia el sistema. Un coste muy importante en una sociedad interconectada como la nuestra, que abre el debate sobre qué hacer para resolver el problema. Uno que requiere equilibrar el incentivo de las empresas para recopilar una cantidad cada vez mayor de datos de los usuarios, con el fin de ofrecer servicios más personalizados y ganar participación en el mercado, y el derecho a la privacidad que, hoy en día, abarca hasta la protección de datos de los usuarios. Por tanto, hay que buscar soluciones que superen la dicotomía entre las solas fuerzas del mercado, o solo la regulación. La primera opción, como veremos, presenta el peligro de la ineficacia a la hora de lograr un resultado óptimo. La segunda, el de cargar a las pequeñas y medianas empresas que operan en el sector de la plataforma digital con un peso de compliance difícil de soportar y que, por ello, se traduciría indirectamente en una ventaja adicional para las empresas incumbentes y su creciente posición de monopolio.

El problema de la manipulación de la privacidad reviste una importancia primordial, no solo porque llega a tener consecuencias en nuestras instituciones más importantes (ver BOX II en Cambridge Analytica), sino porque amenaza con socavar un pilar fundamental de la sociedad: el de la confianza.

CAPÍTULO III. LA PRIVACIDAD

¿Puede existir la privacidad en la era digital? En un mundo hiperconectado, donde las personas están ocupadas interactuando entre sí a diario a través de alguna plataforma digital, ¿resulta posible hablar de un derecho a la privacidad? El hecho mismo de que se formule esta pregunta subraya la profunda transformación respecto al contexto cultural en el que se elaboró la Declaración Universal de Derechos Humanos. El artículo 12 establece lo siguiente:

“Ninguna persona puede ser objeto de interferencias arbitrarias en su vida privada, en su familia, en su casa, en su correspondencia, ni dañar su honor y reputación. Toda persona tiene derecho a ser protegida por la ley contra tales interferencias o lesiones”.

Con estas palabras se quería reafirmar el derecho de toda persona a mantener el control sobre su información: un requisito previo real para el ejercicio de otras libertades. Para ello, el Estado, o cualquier otro sujeto, tenía que abstenerse de interferir arbitraria o ilegalmente en la vida de las personas. A partir de este texto es posible entender que la privacy constituye un derecho difícil de respetar, porque se refiere a una esfera particularmente íntima de la persona y porque, constantemente, ha de lidiar con una tecnología y una necesidad creciente de seguridad, tanto a nivel nacional como internacional.

El desarrollo tecnológico que hemos presenciado en las últimas décadas ha requerido una nueva elaboración del derecho a la privacidad, que se ha ido extendiendo gradualmente hasta el tipo de acceso a la información personal que compartimos al utilizar los servicios digitales, a la protección de los datos contenidos en el mismo, y al control que los usuarios tienen de sus datos.

Vuelven todavía más compleja esta situación, ya de por sí difícil, las heterogéneas actitudes con que los consumidores se ocupan del problema de la privacidad online: divididos entre los que consideran la confidencialidad, a diferentes niveles, algo indispensable, y los que están dispuestos a renunciar a ella para obtener servicios a cambio; un hecho que no se puede olvidar a la hora de diseñar la regulación, y que desaconseja una solución única. La incapacidad de recoger en una sola propuesta esta diversidad de opinión de los usuarios ha sido una fuente de enorme interés para las plataformas digitales, que han cosechado considerables beneficios jugando precisamente con el cambio cultural de los consumidores.

El caso Facebook

Un caso paradigmático lo ofrece Facebook. Desde su fundación en 2003, la popular plataforma ha alternado declaraciones sobre la importancia del respeto a la privacidad con reformas encaminadas a lograr una mayor difusión de la información[58].

En el momento del lanzamiento de esta red social, la privacidad presentaba tal importancia que Facebook creó una línea de especial atención sobre el tema. Un enfoque que recompensaron los consumidores, muchos de los cuales eligieron esta plataforma sobre otros competidores en virtud de esta mejor gestión de la confidencialidad. Ante la existencia de otras redes sociales ya gratuitas como MySpace, Facebook se dio cuenta de la necesidad de una ventaja competitiva para diferenciarse, y lo hicieron respondiendo a la preocupación por la privacidad[59].

Esta estrategia llevó a la empresa a restringir el acceso a aquellos usuarios que podían validar su identidad con una dirección de correo electrónico establecida por una universidad (“.edu”), y las configuraciones por defecto (de default) se diseñaron para que los suscriptores solo pudieran ver el perfil de los colegas universitarios. Contra esto, MySpace tenía opciones predeterminadas más abiertas, y todos los usuarios podían ver las cuentas de los demás[60]. Lo que a primera vista parece un simple detalle, se trata de un elemento que contribuye a la calidad de un producto porque, como demuestra una amplia investigación científica, los consumidores se muestran reacios a cambiar la configuración por defecto, razón por la que la elección de la empresa se convierte para muchos usuarios en la definitiva[61]. Un compromiso adicional respecto al cumplimiento de la privacidad era que Facebook no utilizaría una tecnología como las cookies. Estas—códigos cortos que las plataformas digitales pueden instalar en los ordenadores a través de las URL de sus páginas web— permiten que un sitio recuerde las acciones de un usuario (comprar un producto, iniciar sesión en un sitio) que tuvieron lugar a través de un navegador, a fin de mejorar la calidad de su experiencia en la página web. Al ser también utilizadas para determinar lo que el usuario está buscando, leyendo, o comprando, las cookies constituyen una especie de huella que el internauta deja en la página web visitada, y que puede emplear la empresa propietaria del sitio para rastrear los detalles (ubicación geográfica, hora de visita, dirección IP, ID de cookie) de esa visita. Dos características limitan el uso de cookies por parte de las compañías. La primera, que una empresa solo puede leer sus propias cookies; la segunda, que solo podrá leerlas cuando el usuario inicie una búsqueda en el servidor de su sitio web (la información que puede obtener sobre el usuario se relaciona con lo que es en su sitio web y no en otros)[62].

Por otro lado, es posible que una empresa eluda estas protecciones de privacidad instalando su propio código en la página web de otra compañía, lo que, por supuesto, esta última nunca permitiría (se trata de una simple demostración de cómo la competencia entre empresas se traduce en una mejor privacidad para el usuario). La situación cambia cuando una plataforma como Facebook se convierte en intermediario en la navegación online (por ejemplo, a través de búsquedas en sitios web que se inician a través de la cuenta de Facebook). Esto genera algunas complicaciones a nivel de protección de datos. La primera, que Facebook asocia un determinado ID de cookie con la verdadera identidad de los usuarios, por lo que la búsqueda en una web ya no se corresponderá con un código anónimo, vinculado al ordenador del usuario, sino con la cuenta específica de la red social. La segunda complicación radica en que, de esta manera, Facebook puede recopilar información mucho más integral sobre los gustos y preferencias de los usuarios[63]. Para paliar la preocupación suscitada, Facebook aseguró inicialmente que no controlaba el comportamiento de los usuarios fuera de la plataforma, y también que daba a estos la posibilidad de rechazar la divulgación de su propia información a terceros, así como prohibir que Facebook recopilara información sobre ellos de parte de terceros. Presentarse como una red social ‘cerrada’, con estrictas opciones de privacidad predeterminadas, favoreció que los consumidores la eligieran, lo que dio a Facebook una posición que, a partir de 2014, podría considerarse como de monopolio, según han subrayado varias fuentes citadas en este informe. Una vez asumido este control, Facebook no tardó en comenzar a revisar sus políticas de privacidad, especialmente las relativas a la posibilidad de llevar a cabo operaciones de vigilancia de los usuarios con fines comerciales, utilizando así un esquema tecnológico construido a lo largo de los años, precisamente bajo la promesa de que no lo emplearía con este propósito. Por lo tanto, esa posición de fuerte dominio en el mercado se erigió sobre unos compromisos que se modificaron a posteriori para poder capitalizar aquella. Estos cambios sobre la privacidad no han pasado desapercibidos. Especialmente grave fue el escándalo de Cambridge Analytica (véase BOX II), hasta el punto de que condujo a una nueva reflexión sobre el tema.

Anonimato y control

El caso de Facebook podría sugerir que los problemas de privacidad surgen cuando los usuarios proporcionan información particularmente confidencial (nombre, apellido, dirección). Sin embargo, estudios recientes han demostrado que incluso la “anónima” permite a las plataformas digitales reconstruir la identidad personal. Un ejemplo notable en este sentido lo encontramos en Netflix, una compañía que opera en la distribución y producción a través de Internet de películas, series de televisión y otros servicios de entretenimiento. En 2009, fue acusada de violar el anonimato de algunos usuarios que habían calificado películas y series de televisión registrándose solo con su número ID[64]. Esto sacó a la palestra un problema ya conocido en el mundo de los científicos de la computación: incluso en bases de datos anónimos, donde se eliminan los más sensibles, es suficiente una información inofensiva pero idiosincrática para ser identificado. Se logra a través de un proceso que consiste en cruzar diferentes conjuntos de datos que se combinan con precisión para restringir el campo de identificación del usuario individual[65]. En el mejor de los casos, se pueden usar para políticas publicitarias específicas. El peligro estriba en que los compradores pueden vender los mismos datos, y luego emplearlos para inferir comportamientos futuros que pueden conducir, por ejemplo, a la denegación de una solicitud de crédito o de un trabajo[66].

En general, la preocupación de los usuarios sobre la utilización de sus datos parece aumentar a medida que perciben tener menor control sobre ellos. Recientemente, otros tres gigantes tecnológicos, Google, Apple Inc. y Amazon.com Inc., han sido criticados por hacer que sus empleados escuchen las grabaciones de comandos de voz dirigidos a asistentes digitales como Google Assistant, Siri o Alexa (en el momento de escribir este informe, los reguladores estadounidenses y europeos están investigando posibles violaciones de privacidad). A pesar de una justificación inicial por parte de estas compañías, que alegaban que su pretensión era mejorar aún más el servicio prestado, Google y Apple han suspendido el programa, mientras que Amazon ha anunciado que va a cambiar las condiciones de uso del dispositivo, habilitando la opción de no participar en el servicio de registro (opt-out)[67]. Respecto a este último punto, el nivel de preocupación sigue siendo, sin embargo, elevado. Como muestran algunos informes, la capacidad de los usuarios para sustraerse de este tipo de grabación se ve mermada por la falta de conocimiento sobre su existencia y las opciones que garantizan que el usuario ha consentido el servicio en cuestión[68]. Esto último está vinculado a otro asunto de gran importancia para la privacidad los patrones oscuros, dark patterns. Este término se refiere a unas interfaces gráficas que pueden confundir a los usuarios, dificultando que expresen sus preferencias actuales, o incluso manipularlos y llevarlos a realizar ciertas acciones.

Un ejemplo clásico de un dark pattern es una página web que ofrece la oportunidad de suscribirse a su boletín de noticias, presentando la ventana ‘acepto’ de una manera mucho más fácil de encontrar que la ventana de ‘No, gracias’. En los peores casos, se trata de sitios web diseñados de tal manera que sugieran que, para seguir navegando, es necesario suscribirse al boletín informativo. Ejemplos más agresivos pueden incluir la compra en páginas web que colocan en la ‘cesta’ virtual productos no seleccionados por el usuario, los cuales este tendrá que eliminar pacientemente para evitar adquirirlos. Algunos estudios han demostrado la proliferación de estos caminos engañosos entre los sitios web de compras más populares[69]. La pertinencia de contemplar los patrones oscuros a efectos de este estudio viene de que el proceso que lleva a los usuarios a tomar una determinada decisión afecta enormemente a la cantidad de datos recogidos.

Paradoja de la privacidad y datos empíricos

A esta idea de dar incentivos, en forma de servicios, para que los consumidores de las plataformas digitales publiquen cada vez más datos, la literatura la ha definido como la “paradoja de la privacidad”. Si bien los usuarios reconocen estar preocupados por la difusión de su información, son cada vez más los que comparten sus datos. Para tratar de entender las razones de esta paradoja, resulta útil reanudar algún análisis empírico, y así comparar el tipo de conocimiento que los usuarios tienen con el uso de los propios datos por parte las empresas. Esta información resulta a su vez relevante para medir la voluntad real con que los consumidores difunden su información. Si, de hecho, es cierto que ningún usuario está realmente “obligado” a compartirla, conviene saber el grado de conocimiento sobre las consecuencias de este intercambio. Una voluntad marcada por la ignorancia difícilmente puede considerarse libre.

Por lo tanto, para nuestros propósitos, es útil comprender las percepciones de los consumidores. Para ello, citamos aquí los datos recopilados por el Centro de Investigación Pew, para los ciudadanos estadounidenses, y los del Eurobarómetro para los de la UE. En cuanto a los primeros, refiriéndose a una investigación de 2018, parece que alrededor del 74% de los usuarios de Facebook de EE.UU. no eran conscientes del hecho de que la plataforma digital clasificaba sus intereses (una estrategia necesaria para el ‘target advising’, según lo analizado en el capítulo 2 de este informe) hasta que no fueron dirigidos a la página “your ad preferences” para realizar la encuesta. Una vez tuvieron acceso a esta sección, el 27% de los encuestados aseveraron que no se sentían representados por las listas producidas por los algoritmos, en comparación con el 59% que, en cambio, confirmó la coherencia entre las categorías y sus intereses reales. En cualquier caso, el 51% reportó cierta incomodidad al enterarse de que Facebook había creado esa lista. Una segunda encuesta, que extendió la muestra a los usuarios, no solo de Facebook, sino también de Twitter e Instagram, reveló que estos son conscientes de que sería relativamente fácil para las plataformas utilizadas rastrear sus hábitos en función de los datos recabados. Por otro lado, el funcionamiento preciso de los algoritmos para producir estos análisis sigue resultando casi desconocido para las personas ajenas a las empresas propietarias, así como el proceso de orientación a través del que las compañías de terceros utilizan el material recogido por Facebook[70]. De los resultados de esta encuesta se deduce que más del 70% de la muestra entrevistada permanece ignorante de la categorización de sus intereses por parte de las plataformas digitales y que, una vez descubierta, más de la mitad no se siente cómoda con ello.

Por lo que se refiere a Europa, partimos de un informe publicado por el Eurobarómetro sobre la protección de datos, resultado de una encuesta a los ciudadanos de los 28 Estados miembros de la UE en 2015 (antes de la entrada en vigor del Reglamento General de Protección de Datos (RGPD))[71].

Según este, el 31% de los consultados piensa que no tiene control sobre la información que se proporciona online. La inquietud no nace simplemente de la recopilación de estos datos por parte de empresas privadas, sino también de los gobiernos. En cuanto a la concienciación de los usuarios sobre la recolección de sus datos y su utilización por las plataformas, solo la mitad respondieron que siempre estaban al corriente de los métodos de obtención de datos y sus usos potenciales cuando se solicita información privada. Del mismo modo, solo el 20% de los encuestados dice que leyó sus declaraciones de privacidad online en su totalidad antes de dar el consentimiento; la mayoría de los que admitieron que no las leyeron adujeron que eran demasiado largas. Así, estas declaraciones se consideran demasiados complejas y poco claras (Luxemburgo 52%, Francia 47%, España 46%).

El Estado

A los riesgos provenientes del mundo privado se suman los no menos importantes vinculados al control gubernamental. En Estados Unidos, ya en el año 2000, la Comisión Federal de Comercio había recomendado al Congreso que se regulara la privacy online[72]. A pesar de esto, después de los ataques del 11 de septiembre de 2001 contra las Torres Gemelas en Nueva York, la atención general se centró en el tema de la seguridad, dejando la privacidad en un segundo plano. Por otro lado, la economía digital ha continuado captando paulatinamente el interés de los gobiernos, sobre todo porque entendieron que detrás de este sector se escondía la posibilidad de disponer de un mayor acceso a los datos y, por lo tanto, un mayor control sobre las personas. La recogida masiva y el análisis de datos personales ha fortalecido a los gobiernos, que, hoy en día, probablemente saben más que nunca sobre sus ciudadanos.

De hecho, Laura Poitras, directora de la película documental Citizenfour, que recrea el escándalo de espías reportado por Snowden, en una entrevista con The Washington Post en 2014 declaró que “Facebook es un regalo para las agencias de inteligencia”[73]. El tipo de información que se ofrece actualmente otorga a los gobiernos la capacidad de anticipar protestas e, incluso, arrestar preventivamente a las personas que piensan que tomarán parte en estas.

En la misma línea, durante los últimos 20 años, el gobierno estadounidense ha activado un programa de vigilancia electrónica operado por la Agencia de Seguridad Nacional con el cual recaban datos a través de Google, Facebook y otras empresas de tecnología[74]. Este programa, llamado ‘PRISM’, se utiliza para rastrear búsquedas online, contenidos de correos, o conversaciones entre usuarios. Las plataformas han negado que colaboren con él, y han reiterado que la información que ofrecen al gobierno está siempre bajo el respeto a la ley y la privacidad de las personas[75].

Sin embargo, como veremos más adelante, hoy la gran amenaza para el derecho de los ciudadanos a la privacidad proviene de la unión entre Big State y Big Corporation. Por un lado, las plataformas digitales tienen una penetración que les permite reunir una gran cantidad de información; por otro, el Estado ostenta potencialmente la autoridad para acceder a estos datos. Por esta razón, es urgente pensar en una solución que no esté orientada simplemente a regular estas plataformas, sino también a reducir su poder; poder que, en un análisis final, puede transferirse a las autoridades en detrimento de los individuos.

‘Notice and Consent’, Paternalismo y ‘Nudging’

Frente a esta imagen tan poco alentadora, vale la pena centrarse en la posible salida. Hasta hace poco, el enfoque sobre la privacidad más utilizado era el anglosajón, caracterizado por tratar de empoderar en la medida de lo posible al usuario individual, a fin de evitar un intervencionismo exagerado y salvaguardar la libertad de las personas; este modelo se define típicamente como ‘notice and consent’, observar y consentir. En la práctica, en lo que podríamos llamar autogestión de la privacidad, se basaba en consultar a los usuarios qué tipo de recopilación de datos deseaban, garantizando el derecho de elección y que esta transferencia fuera segura gracias a tecnologías y procedimientos adecuados. El objetivo que perseguía este enfoque consistía en aumentar la alfabetización de los usuarios en términos de privacidad. A pesar de la noble intención, hay varias razones que han llevado a su replanteamiento. En primer lugar, el hecho de que los datos se almacenen hoy en día tras el uso de cualquier servicio online ha motivado que sea humanamente imposible ejercer un proceso continuo de toma de decisiones racionales para consentir su procesamiento. Además, el que haya cada vez más pop-ups que nos advierten de cualquier problema de privacidad se percibe como un obstáculo que hay que superar con el fin de obtener un servicio. A esto hay que añadir que el permiso o prohibición debe darse siempre en tiempo real, lo que dificulta la reflexión y aumenta el riesgo de que el aviso sobre la privacidad sea ignorado.

Por último, no ayuda a mejorar la situación que el tipo de preguntas formuladas a los consumidores resulte a menudo demasiado complejo, o emplee una jerga extremadamente técnica. Los estudios académicos muestran que la información proporcionada a los usuarios es demasiado voluminosa e intrincada para que estos la lean, entiendan y tomen decisiones que reflejen sus valores, preferencias e intereses[76]. Si los internautas se relacionaran con solo unas pocas realidades, ese enfoque seguiría siendo concebible, pero en un mundo donde tienen docenas de aplicaciones en sus teléfonos y están constantemente conectados con otros dispositivos, en casa y en el trabajo, pensar que se puede llevar a cabo este trabajo de alfabetización no es realista. Muy a menudo, los usuarios confirman el pop-up sin leer, con la esperanza de que nada grave sucederá. Todo ello invita a descartar el enfoque de ‘notice and consent’.

En el otro extremo, encontramos un enfoque paternalista, que tiene como objetivo limitar significativamente la capacidad de las empresas a la hora de recopilar los datos de los usuarios. También presenta algunos inconvenientes importantes, como no reconocer la heterogeneidad de opiniones de los usuarios sobre el uso de sus datos. Frente a los que están particularmente preocupados por su privacidad, hay otros que están dispuestos a conceder información sobre sí mismos a cambio de servicios. Por tanto, una aproximación excesivamente paternalista conlleva el riesgo de borrar esta distinción y reducir así la libertad de acción de los consumidores.

El tercer enfoque posible es el del liberalismo paterno;asociado con el concepto de nudging, que desarrolló el premio Nobel de la Economía Richard Thaler[77]. Este concepto, aplicado al contexto de la privacidad y la protección de datos, se traduce concretamente en los ajustes de default (o predeterminados). Su ventaja está relacionada con el sesgo del statu quo, por el que, una vez se toma una determinada decisión, hay una preferencia exagerada por mantenerla. Por lo general, este sesgo se analiza respecto a la elección de los fondos de pensiones, pero recientemente se ha pensado aplicarlo también al contexto de la privacidad. Lo interesante para nuestro caso es que la mayoría de las plataformas digitales que recogen datos ofrecen por defecto las opciones de máxima divulgación por parte de los usuarios. Por tanto, una ley que obligara a estos recopiladores a establecer como opciones predeterminadas aquellas más conservadoras con la divulgación de información sensible, a menos que el usuario decida lo contrario, podría garantizar una mejor protección de la privacidad. Recientemente, un informe publicado por el Stigler Centre de la Universidad de Chicago sugería que, cuando las preferencias y expectativas de los consumidores (recogidas a través de estudios científicos) coincidan con las prácticas de las empresas, estas opciones deberían adoptarse por defecto. Sin embargo, cuando las preferencias y expectativas de los consumidores difieran de las de las empresas, resultaría más apropiado utilizar las opciones de los consumidores como regla de default, dejando espacio para la flexibilidad en caso de que las compañías fueron capaces de convencer a aquellos sobre las bondades de su propuesta[78]. Nos extenderemos en el capítulo 4 sobre la coherencia de este planteamiento con lo que ha adelantado la reforma del RGPD. Así, su propuesta parece compatible, por un lado, con la diversidad de preferencias de los usuarios, y por otro, evita que, aprovechándose de esta, las plataformas digitales pueden manipularlos y empujarles a que tomen decisiones que amenacen su bienestar.

Queda por ver hasta qué punto la propuesta de nudging respeta los principios del liberalismo clásico, perspectiva desde la que este informe quiere contribuir al debate sobre plataformas digitales y privacidad. A este respecto, es importante, en primer lugar, subrayar la diferencia entre esta forma de liberalismo y otras fórmulas más extremas que se remontan al ‘anarco-liberalismo’, que, en su vertiente tecnológica, se ha definido como ‘cripto-liberalismo’[79].

Estos últimos temas abarcan puntos de vista bastante extremos, y probablemente idealistas, sobre el potencial de la tecnología para fortalecer la libertad. Por contra, el liberalismo clásico reconoce el valor y la utilidad de un marco regulatorio capaz de respetar la autonomía y facilitar las transacciones voluntarias y de beneficios entre individuos. De hecho, estas reglas están configuradas para proteger esa autonomía individual, indispensable para que las personas puedan elegir libremente[80].

Al desgranar los méritos de la propuesta de este informe, la idea de nudging, asociada con el paternalismo liberal, se basa en el hecho de que haya ‘expertos’ capaces de enmarcar opciones, de tal manera que las preferencias personales coincidan con lo que los usuarios ‘deberían’ elegir por su propio bien. Tradicionalmente, la idea de un grupo de expertos que elija en nombre del resto de la población choca con esos principios de autonomía específicos del liberalismo, por los cuales las personas, a través del ejercicio de su libertad y la posibilidad de cometer errores, crecen en responsabilidad y capacidad de progreso.

La crítica del mundo libertario acerca de la efectividad de estos ‘expertos’ es correcta, incluso corriendo el riesgo de olvidar otra dimensión también importante. Si podemos pensar que los ‘expertos’, aliasel gobierno, representan una amenaza para la libertad y la autonomía individual, también debemos tener en cuenta que, en el contexto de la privacy online, la elección del usuario nunca se produce de una manera totalmente neutral. A las sugerencias de los ‘expertos’, que pueden crear distorsiones, se opone una opción de ‘default’ diseñada por y para el beneficio exclusivo de las plataformas digitales (para que recopile la mayor cantidad de datos posible). En ese contexto, hay que evitar soluciones que se aferren a motivaciones ideológicas.

Por ello, la propuesta de reglas por defecto basadas en las preferencias de los consumidores es consistente con un liberalismo que no se cierra tout court a un conjunto de normas. En este caso, se recurriría a los ‘expertos’ para identificar científicamente las preferencias promedio de los usuarios, y sugerir opciones predeterminadas acordes con estos datos, y no con opiniones personales o institucionales (o razones de Estado no especificadas) . Además, hay que reiterar cómo esta propuesta no excluye a los usuarios dispuestos a compartir su información.

En este sentido, una legislación capaz

de defender la diversidad de preferencias, y por tanto de elección, de los

consumidores, y de evitar al mismo tiempo que las empresas que operan en el

sector digital se muevan sin ningún tipo de restricción, se trata de una buena solución,

coherente con una libertad individual y responsable.

CAPÍTULO IV. EL FUNCIONAMIENTO DEl RPDG

El Reglamento General de Protección de Datos (RPDG) es, sin duda, el proyecto de ley sobre privacidad y protección de datos más ambicioso en vigor. Se aplica en los países miembros de la UE desde mayo de 2018, y, poco a poco, se está convirtiendo también en una referencia para leyes similares en el resto del mundo. Por esta razón, analizarlo resulta indispensable para los fines de nuestro informe, que no realizará, sin embargo, un estudio detallado, sino que se limitará a destacar algunos aspectos relacionados con sus consecuencias sobre el usuario y las empresas.

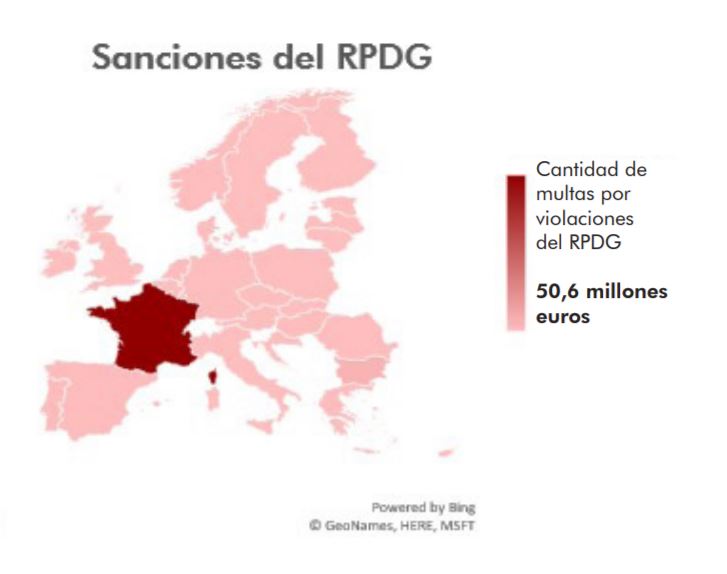

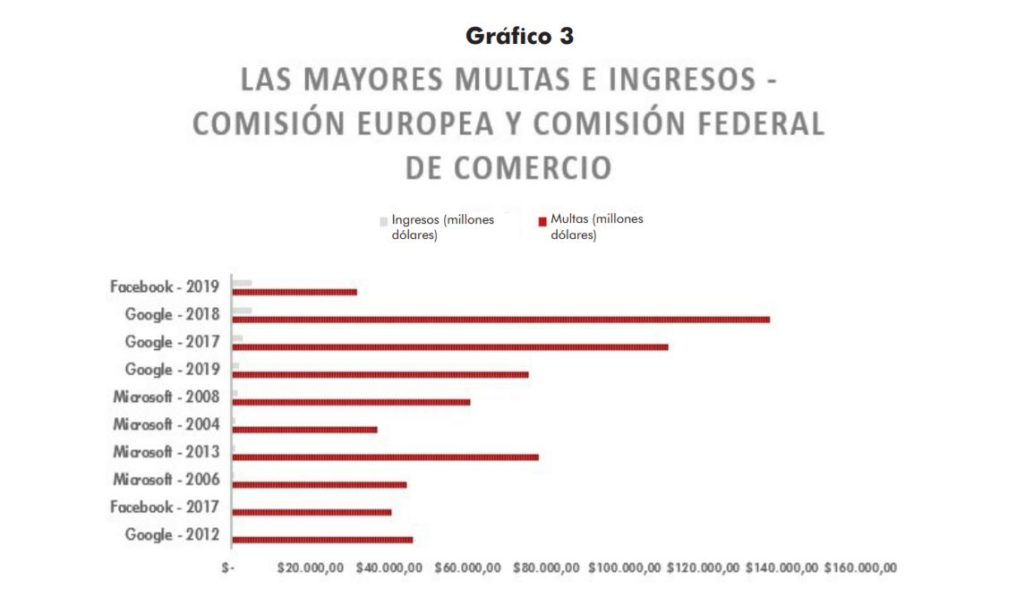

El punto de partida es que el RPDG ha impuesto reglas estrictas para el procesamiento de datos por parte de las plataformas digitales, y ha creado derechos significativos para los usuarios. El Reglamento define como datos personales toda aquella información relacionada con una persona identificable o identificada —también denominada «interesada» (Art. 3)—, y prevé una mayor protección de aquella considerada sensible, incluyendo raza, estado de salud, orientación sexual y antecedentes penales. Su aplicación se extiende a todas las entidades registradas en la UE, incluidas las extranjeras que procesan datos personales de los residentes comunitarios, cuya actividad se refiere a la prestación de bienes y servicios, así como a la recopilación de datos destinados a rastrear comportamientos. Las autoridades nacionales a cargo, normalmente los distintos garantes de la privacy, ejercen una función de supervisión y, en caso de incumplimiento, pueden emitir multas de hasta el 4% de los ingresos totales de una empresa, o de 20 millones de euros, dependiendo de cuál de ambas cifras sea mayor. El RPDG también brinda a asociaciones comerciales y organizaciones sin ánimo de lucro la posibilidad de iniciar una class action que permite demandar a ciertas compañías por cuenta de los consumidores.

En cuanto a los sujetos dedicados al tratamiento de los datos, el RPDG introduce una diferencia entre los “data collectors” (los dueños del tratamiento) y los “data processors” (responsables del tratamiento) (Cap. 4 – Art. 24-43). Los primeros determinan la finalidad de la recopilación de datos y los medios para su tratamiento, mientras que los segundos, después de recibirlos, se ocupan de gestionarlos. Los propietarios están obligados, en general, a cumplir con una serie de deberes, que incluyen el de demostrar laconformidad,no solo de ellos mismos, sino también de los responsables, los cuales también han de supervisar el comportamiento, y revelar la existencia de cualesquiera terceras partes que gestionarán los datos de los consumidores. Son siempre los propietarios los que luego tienen que informar a estos de cómo se utilizarán aquellos, por cuánto tiempo se retendrán, y cómo se respetarán los derechos a ellos inherentes.

En lo que respecta a los fundamentos en los que se basa toda la estructura regulatoria, hemos de referirnos a dos principios (introducidos en el Art. 25): el de ‘privacy by design’ y ‘privacy by default’. El primero implica un enfoque conceptual que requiere que las empresas inicien un proyecto, proporcionando desde el comienzo la configuración correcta para proteger los datos personales, como el uso de seudónimos o la minimización de la información presente en la estructura de productos y servicios. Este principio gira, por un lado, alrededor de la idea de que los problemas deben abordarse en la fase de diseño para evitar que se produzcan riesgos, y por otro, en la centralidad de los derechos y de las respuestas claras y rápidas a las solicitudes de acceso.

Con el principio de ‘privacy by default’ se ha procurado, por el contrario, asegurar que, por defecto, las empresas tienen que tratar los datos personales solo en la medida en que se necesite para los fines fijados y durante el período estrictamente requerido. Esto permitiría al usuario recibir un alto nivel de protección, incluso sin esforzarse a la hora de limitar la recopilación de datos (por ejemplo, habilitando la opción ‘opt out’). En este sentido, podemos ver cómo estos principios son coherentes con el enfoque de nudging presentado en el capítulo 3. Su introducción, por otra parte, obliga a las empresas a preparar una evaluación del ‘impacto de la privacidad’ cada vez que se lanza un proyecto que prevé un tratamiento de datos. Esto no puede subestimarse, ya que genera una serie de costes para las empresas en el que nos detendremos más adelante.

Si bien el RPDG ha aumentado las obligaciones regulatorias para las compañías, también ha alumbrado una serie de derechos para los consumidores. Así, los interesados pueden solicitar que los propietarios y responsables faciliten una explicación del tipo de datos que están recopilando y cómo se utilizarán en el futuro, así como pedir que sus datos sean corregidos o eliminados. Aunque los titulares pueden compartir la información de los interesados con terceros para cumplir con el objetivo inicial del tratamiento, no pueden hacerlo con un fin diferente, a menos que el consumidor lo permita o el titular emplee una nueva base legal. Los datos personales pueden transferirse fuera de la UE, pero, en general, solo a aquellos países en los que la protección de la privacy esté en vigor de una forma equivalente (una decisión que depende de la Comisión Europea).